ノーコードでクラウド上のデータとの連携を実現。

詳細はこちら →CData Software Japan - ナレッジベース

Latest Articles

- MySQL のデータをノーコードでREST API として公開する方法:CData API Server

- CData Sync AMI をAmazon Web Services(AWS)で起動

- Connect Cloud Guide: Derived Views, Saved Queries, and Custom Reports

- Connect Cloud Guide: SSO (Single Sign-On) and User-Defined Credentials

- Connect Cloud クイックスタート

- Shopify APIのバージョンアップに伴う弊社製品の対応について

Latest KB Entries

- DBAmp: Serial Number Expiration Date Shows 1999 or Expired

- CData Drivers のライセンスについて

- Spring4Shell に関する概要

- Update Required: HubSpot Connectivity

- CData Sync で差分更新を設定

- Apache Log4j2 Overview

ODBC Drivers

- [ article ] Java のJDBC-ODBC Bridge ...

- [ article ] データ統合ツールQlik Replicate を使ってRSS のデータをMySQL ...

- [ article ] Waha! Transformer からCData Software ODBC Driver ...

- [ article ] Tableau Bridge でTableau Cloud からのAzure Synapse ...

JDBC Drivers

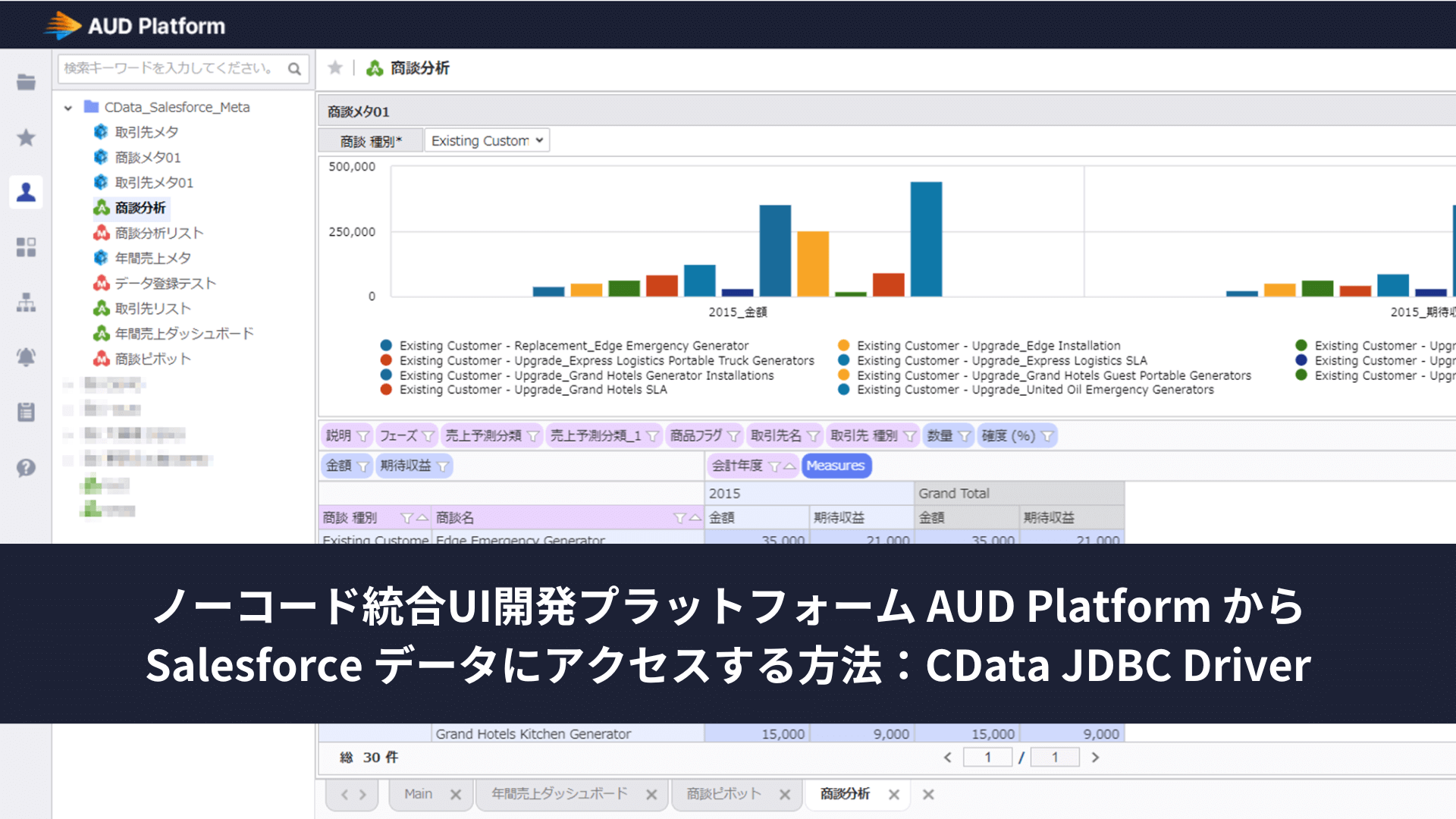

- [ article ] Salesforce データをDataSpider Servista の連携先として使う方法

- [ article ] DBeaver からBカート データに接続する方法

- [ article ] PowerBuilder からAzure Analysis Services データに連携

- [ article ] SnapLogic でInstagram を外部サービスに連携

SSIS Components

- [ article ] SSIS を使ってeBay Analytics データをSQL Server にインポート

- [ article ] Databricks データからSQL Server ...

- [ article ] SSIS を使ってFacebook データをSQL Server にインポート

- [ article ] SSIS を使ってPinterest データをSQL Server にインポート

ADO.NET Providers

- [ article ] PowerBuilder からクラウドサイン データに接続してみた

- [ article ] Visual Studio でチャートコントロールと Salesforce をデータバインド

- [ article ] Microsoft OneDrive データをDevExpress Data Grid ...

- [ article ] SSAS でPonparemall データに連携するOLAP Cube を作成

Excel Add-Ins

- [ article ] Microsoft Power BI Designer でCData Software ODBC ...

- [ article ] Power Automate を使用してExcel データを自動化タスクに統合

- [ article ] RPA ツールUiPath でExcel Online データを連携利用する方法

- [ article ] Mac OS X 上のMS Excel でSuiteCRM データを連携利用

API Server

- [ article ] PHP でMySQL からOData データにアクセス

- [ article ] Visual Studio でチャートコントロールと OData をデータバインド

- [ article ] OData とのデータ連携ができるMVC アプリケーションの作成

- [ article ] Excel データを使った動的なReact アプリケーションを作成する方法

Data Sync

- [ article ] 複数のSurveyMonkey アカウントのレプリケーション

- [ article ] Google BigQuery へのOdoo データのETL/ELT ...

- [ article ] TigerGraph データをSQL Server に連携して利用する4つの方法を比較

- [ article ] 複数のSuiteCRM アカウントのレプリケーション

Windows PowerShell

- [ article ] Ponparemall データをPowerShell script でSQL Server ...

- [ article ] FTP データをPowerShell script でSQL Server にレプリケートする方法

- [ article ] PowerShell からSurveyMonkey ...

- [ article ] Microsoft OneDrive データをPowerShell script でSQL ...

FireDAC Components

- [ article ] Delphi のSAP Concur データへのデータバインドコントロール

- [ article ] Delphi のSAS Data Sets データへのデータバインドコントロール

- [ article ] Delphi のAmazon Athena データへのデータバインドコントロール

- [ article ] Delphi のYahoo! JAPAN DATA SOLUTION ...