ノーコードでクラウド上のデータとの連携を実現。

詳細はこちら →CData Software Japan - ナレッジベース

Latest Articles

- MySQL のデータをノーコードでREST API として公開する方法:CData API Server

- CData Sync AMI をAmazon Web Services(AWS)で起動

- Connect Cloud Guide: Derived Views, Saved Queries, and Custom Reports

- Connect Cloud Guide: SSO (Single Sign-On) and User-Defined Credentials

- Connect Cloud クイックスタート

- Shopify APIのバージョンアップに伴う弊社製品の対応について

Latest KB Entries

- DBAmp: Serial Number Expiration Date Shows 1999 or Expired

- CData Drivers のライセンスについて

- Spring4Shell に関する概要

- Update Required: HubSpot Connectivity

- CData Sync で差分更新を設定

- Apache Log4j2 Overview

ODBC Drivers

- [ article ] Tally データをR で分析

- [ article ] Domo Workbench のActiveCampaign からデータセットを作成し、Domo ...

- [ article ] PowerPivot でFHIR データを連携して取得し分析

- [ article ] Power View でのWordPress データのインポートとビジュアライズ

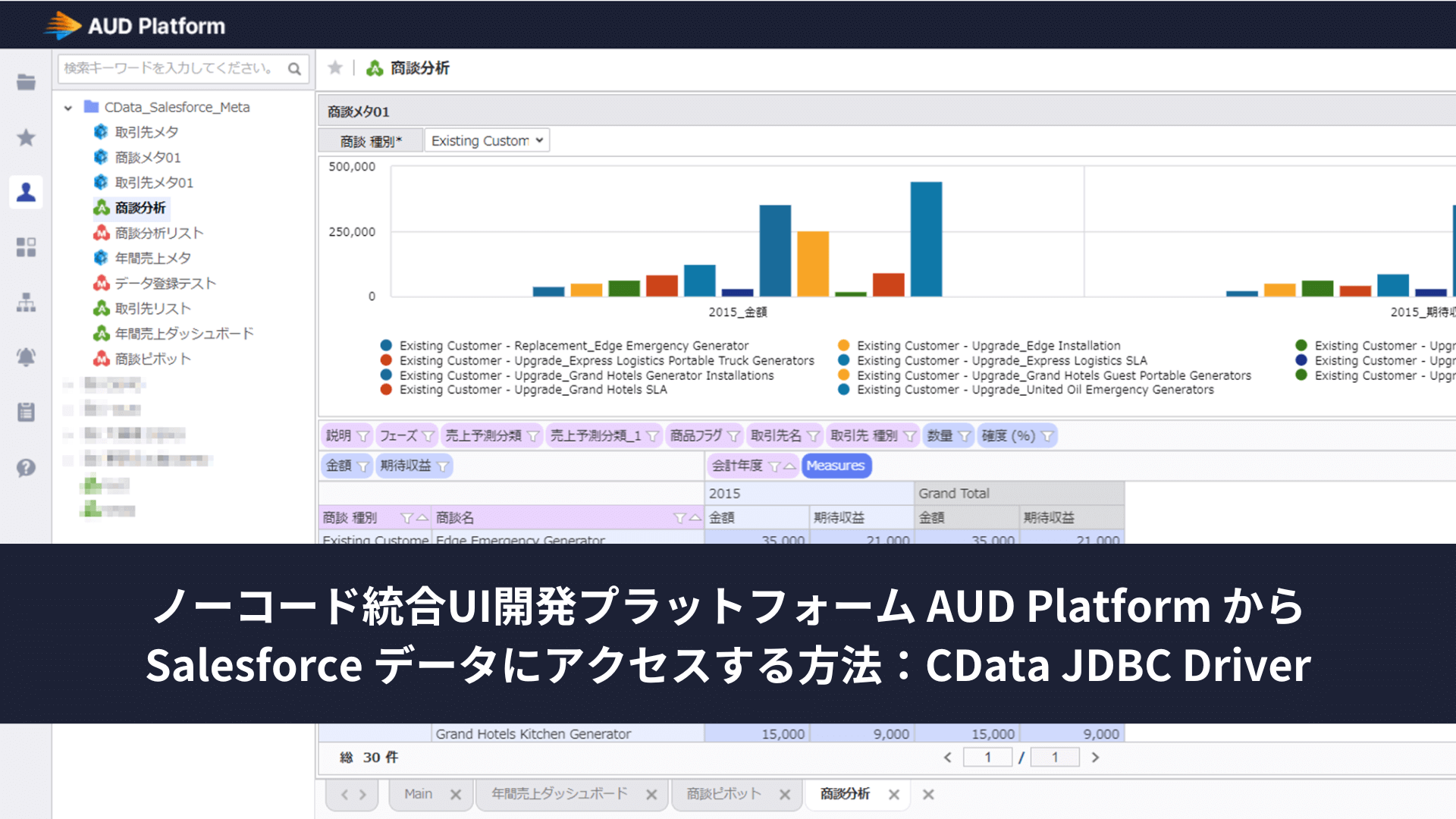

JDBC Drivers

- [ article ] Apache Spark でTeradata データをSQL で操作する方法

- [ article ] ETL/ELT のEmbulk を使ってBing Ads データをDB にロードする方法

- [ article ] MicroStrategy Web でCData Software JDBC Driver for ...

- [ article ] PowerBuilder からBing Ads データに連携

SSIS Components

- [ article ] FTP データからSQL Server に接続する4つの方法をご紹介。あなたにピッタリな方法は?

- [ article ] RSS をSSIS 経由でSQL サーバーにバックアップする

- [ article ] QuickBase データからSQL Server ...

- [ article ] ShipStation データからSQL Server ...

ADO.NET Providers

- [ article ] ColdFusion にリアルタイムBing Search ...

- [ article ] Entity Framework 6 からPipedrive データに連携

- [ article ] ColdFusion にリアルタイムMonday.com ...

- [ article ] Bing Search をSSIS 経由でSQL サーバーにバックアップする

Excel Add-Ins

- [ article ] CDATAQUERY 関数を使って、Excel スプレッドシートにSybase を自動挿入

- [ article ] CDATAQUERY 関数を使って、Excel スプレッドシートにStripe を自動挿入

- [ article ] CDATAQUERY 関数を使って、Excel スプレッドシートにe-Sales Manager ...

- [ article ] SharePoint Excel Services からCData ODBC Driver for ...

API Server

- [ article ] PowerShell からOData データに接続してデータの取得・更新・挿入・削除・CSV ...

- [ article ] DB2 へのOData データのETL/ELT パイプラインを作ってデータを統合する方法

- [ article ] OpenOffice Base でOData データをクエリする方法

- [ article ] RapidMiner からOData データに連携

Data Sync

- [ article ] 複数Smartsheet アカウントをレプリケーション

- [ article ] Amazon Marketplace データを複数のデータベースにレプリケーション。

- [ article ] Vertica へのExcel Online データのETL/ELT ...

- [ article ] Splunk データのAzure SQL への自動レプリケーション。

Windows PowerShell

- [ article ] Asana データをPowerShell script でSQL Server ...

- [ article ] Act CRM データをPowerShell script でSQL Server ...

- [ article ] Yahoo! Shopping データをPowerShell script でSQL Server ...

- [ article ] Shopify データをPowerShell script でSQL Server ...

FireDAC Components

- [ article ] Delphi のSnapchat Ads データへのデータバインドコントロール

- [ article ] Delphi のGmail データへのデータバインドコントロール

- [ article ] Delphi のSage Cloud Accounting データへのデータバインドコントロール

- [ article ] Delphi のSharePoint データへのデータバインドコントロール