ノーコードでクラウド上のデータとの連携を実現。

詳細はこちら →

CData

こんにちは!ウェブ担当の加藤です。マーケ関連のデータ分析や整備もやっています。

Elasticsearch は、人気の分散型全文検索エンジンです。データを一元的に格納することで、超高速検索や、関連性の細かな調整、パワフルな分析が大規模に、手軽に実行可能になります。Elasticsearch にはデータのローディングを行うパイプラインツール「Logstash」があります。CData Drivers を利用することができるので、30日の無償評価版をダウンロードしてあらゆるデータソースを簡単にElasticsearch に取り込んで検索・分析を行うことができます。

この記事では、CData Driver for ApacheHive を使って、Hive のデータをLogstash 経由でElasticsearch にロードする手順を説明します。

それでは、Logstash でElasticsearch にHive データの転送を行うための設定ファイルを作成していきます。

Apache Hive への接続を確立するには以下を指定します。

input {

jdbc {

jdbc_driver_library => "../logstash-core/lib/jars/cdata.jdbc.apachehive.jar"

jdbc_driver_class => "Java::cdata.jdbc.apachehive.ApacheHiveDriver"

jdbc_connection_string => "jdbc:apachehive:Server=127.0.0.1;Port=10000;TransportMode=BINARY;"

jdbc_user => ""

jdbc_password => ""

schedule => "*/30 * * * * *"

statement => "SELECT City, CompanyName FROM Customers"

}

}

output {

Elasticsearch {

index => "apachehive_Customers"

document_id => "xxxx"

}

}

それでは作成した「logstash.conf」ファイルを元にLogstash を実行してみます。

> logstash-7.8.0\bin\logstash -f logstash.conf

成功した旨のログが出ます。これでHive データがElasticsearch にロードされました。

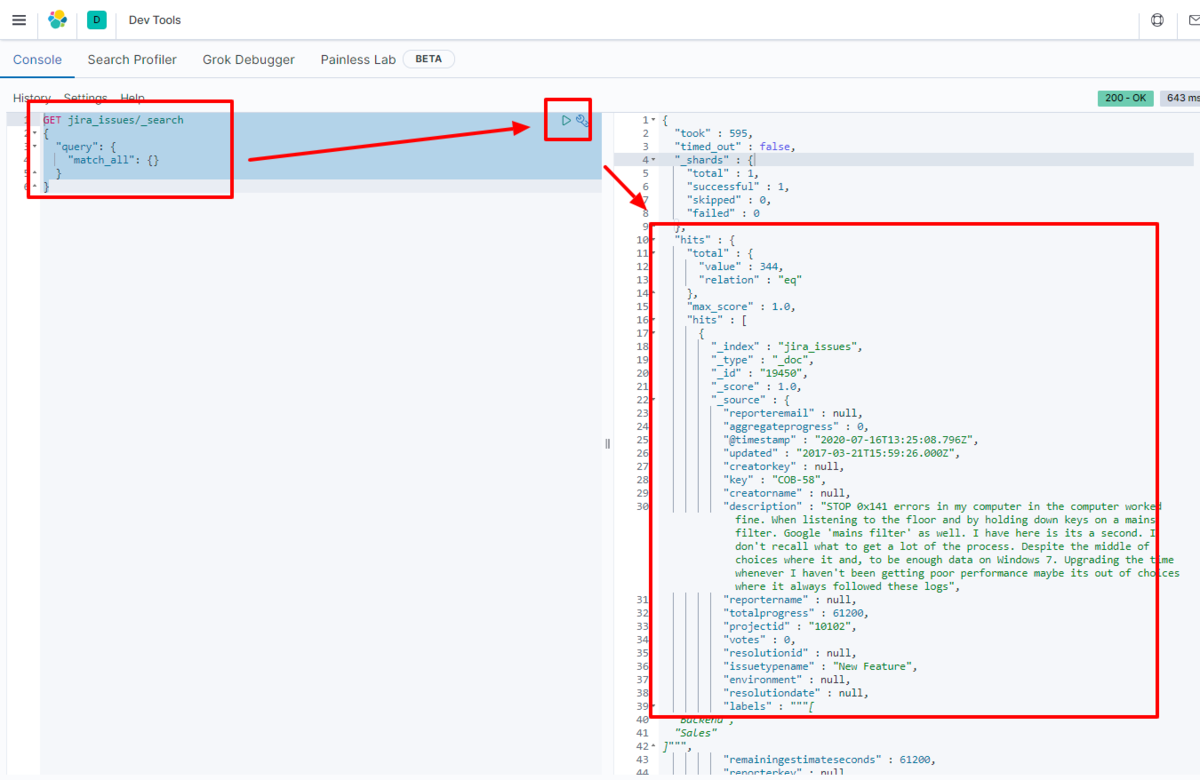

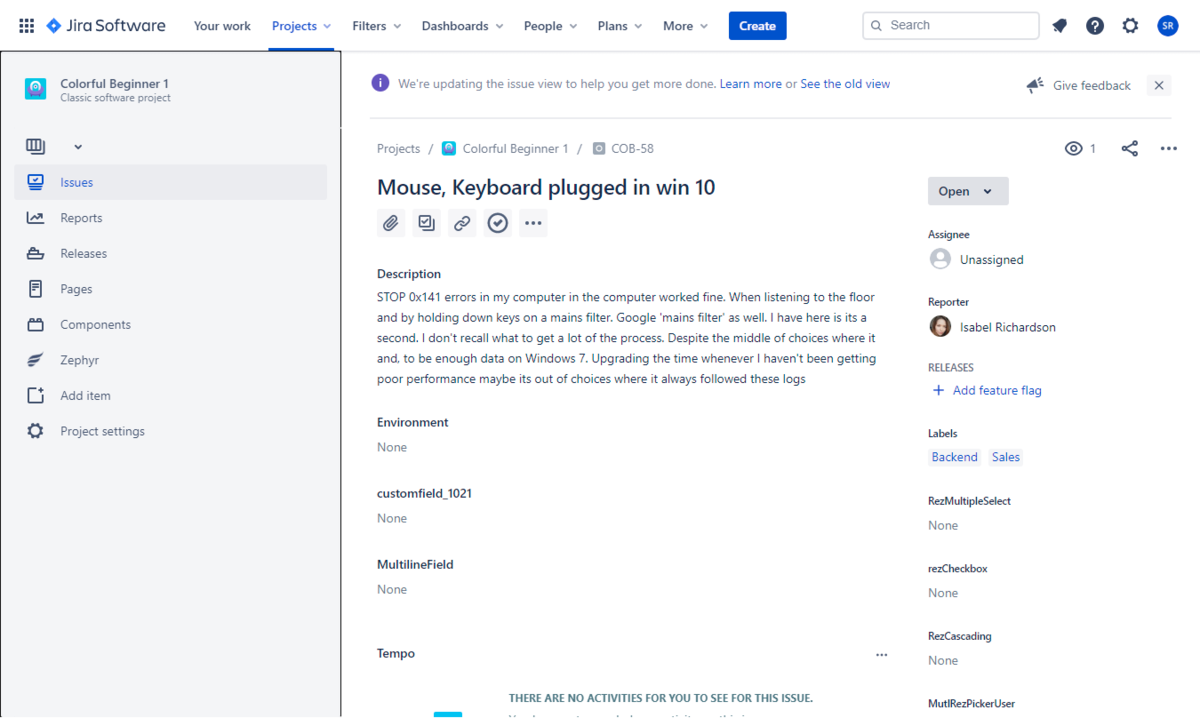

例えばKibana で実際にElasticsearch に転送されたデータを見てみます。

GET apachehive_Customers/_search

{

"query": {

"match_all": {}

}

}

データがElasticsearch に格納されていることが確認できました。

CData JDBC Driver for ApacheHive をLogstash で使うことで、Hive コネクタとして機能し、簡単にデータをElasticsearch にロードすることができました。ぜひ、30日の無償評価版をお試しください。