ノーコードでクラウド上のデータとの連携を実現。

詳細はこちら →

CData

こんにちは!ドライバー周りのヘルプドキュメントを担当している古川です。

Apache Airflow を使うと、データエンジニアリングワークフローの作成、スケジューリング、および監視を行うことができます。CData JDBC Driver for SSAS と組み合わせることで、Airflow からリアルタイムSQL Analysis Services データに連携できます。 この記事では、Apache Airflow インスタンスからSQL Analysis Services データに接続してクエリを実行し、結果をCSV ファイルに保存する方法を紹介します。

最適化されたデータ処理が組み込まれたCData JDBC Driver は、リアルタイムSQL Analysis Services データを扱う上で高いパフォーマンスを提供します。 SQL Analysis Services にSQL クエリを発行すると、CData ドライバーはフィルタや集計などのSQL Analysis Services 側でサポートしているSQL 操作をSQL Analysis Services に直接渡し、サポートされていない操作(主にSQL 関数とJOIN 操作)は組み込みSQL エンジンを利用してクライアント側で処理します。 組み込みの動的メタデータクエリを使用すると、ネイティブのデータ型を使ってSQL Analysis Services データを操作および分析できます。

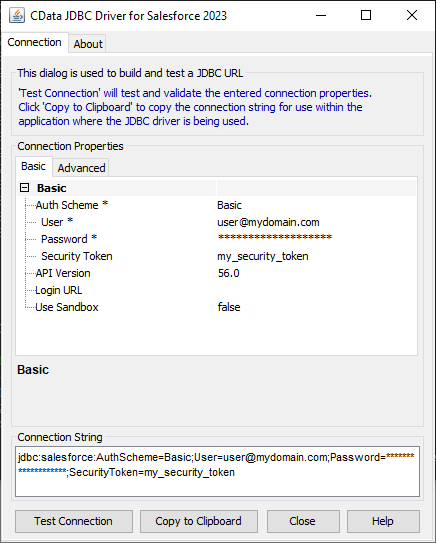

JDBC URL の作成の補助として、SQL Analysis Services JDBC Driver に組み込まれている接続文字列デザイナーが使用できます。JAR ファイルをダブルクリックするか、コマンドラインからjar ファイルを実行します。

java -jar cdata.jdbc.ssas.jar

接続プロパティを入力し、接続文字列をクリップボードにコピーします。

接続するには、Url プロパティを有効なSQL Server Analysis Services エンドポイントに設定して認証を提供します。XMLA アクセスを使用して、HTTP 経由でホストされているSQL Server Analysis Services インスタンスに接続できます。 Microsoft ドキュメント configure HTTP access を参照してSQL Server Analysis Services に接続してください。

SQL をSQL Server Analysis Services に実行するには、ヘルプドキュメントの「Analysis Services データの取得」を参照してください。接続ごとにメタデータを取得する代わりに、CacheLocation を設定できます。

AuthScheme を"Basic" または"Digest" に設定してUser とPassword を設定します。CustomHeaders に他の認証値を指定します。

Windows のUser とPassword を設定して、AuthScheme をNTLM に設定します。

Kerberos を認証するには、AuthScheme をNEGOTIATE に設定します。Kerberos 委任を使うには、AuthScheme をKERBEROSDELEGATION に設定します。必要があれば、User、Password およびKerberosSPN を設定します。デフォルトでは、CData 製品は指定されたUrl でSPN と通信しようと試みます。

デフォルトでは、CData 製品はサーバーの証明書をシステムの信頼できる証明書ストアと照合してSSL/TLS のネゴシエーションを試みます。別の証明書を指定するには、利用可能なフォーマットについてヘルプドキュメントの「SSLServerCert」プロパティを参照してください。

接続を設定したら、その後はあらゆるキューブを二次元テーブルとして扱うことができます。データに接続する際にCData 製品がSSAS のメタデータを取得して、動的にテーブルスキーマを更新します。 「CacheLocation」プロパティを設定すれば自動でファイルにキャッシュを作成するので、接続時に毎回メタデータを取得する必要もなくなります。

詳細は、ヘルプドキュメントの「Retrieving Analysis Services Data」を参照してください。

クラスタ環境またはクラウドでJDBC ドライバーをホストするには、ライセンス(フルまたはトライアル)およびランタイムキー(RTK)が必要です。本ライセンス(またはトライアル)の取得については、こちらからお問い合わせください。

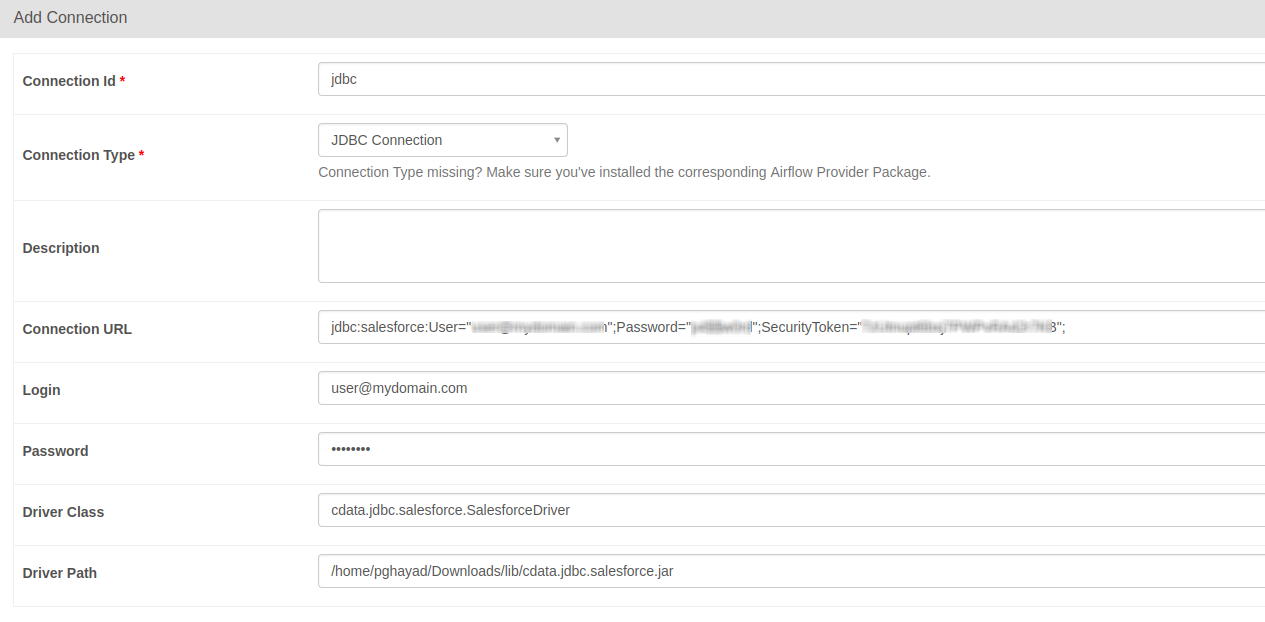

以下は、JDBC 接続で要求される必須プロパティです。

| プロパティ | 値 |

|---|---|

| Database Connection URL |

jdbc:ssas:RTK=5246...;User=myuseraccount;Password=mypassword;URL=http://localhost/OLAP/msmdpump.dll;

|

| Database Driver Class Name | cdata.jdbc.ssas.SSASDriver |

jdbc:ssas:RTK=5246...;User=myuseraccount;Password=mypassword;URL=http://localhost/OLAP/msmdpump.dll;

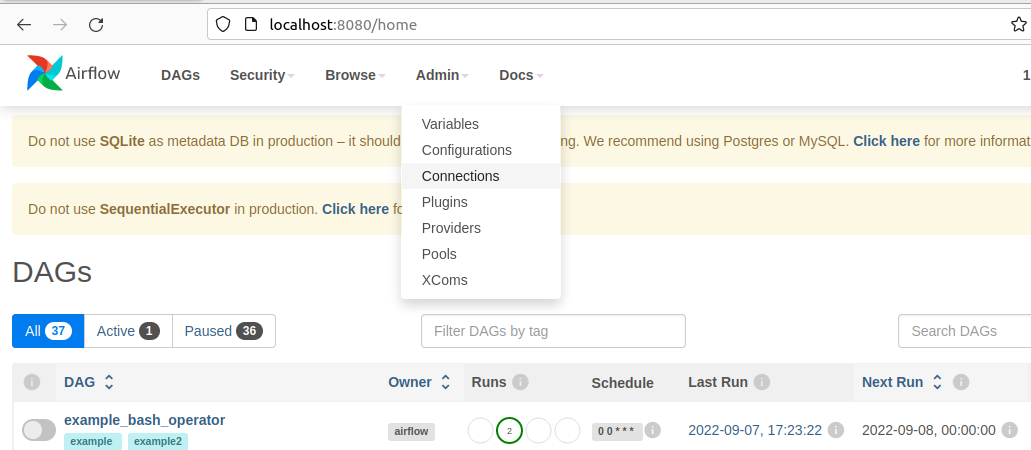

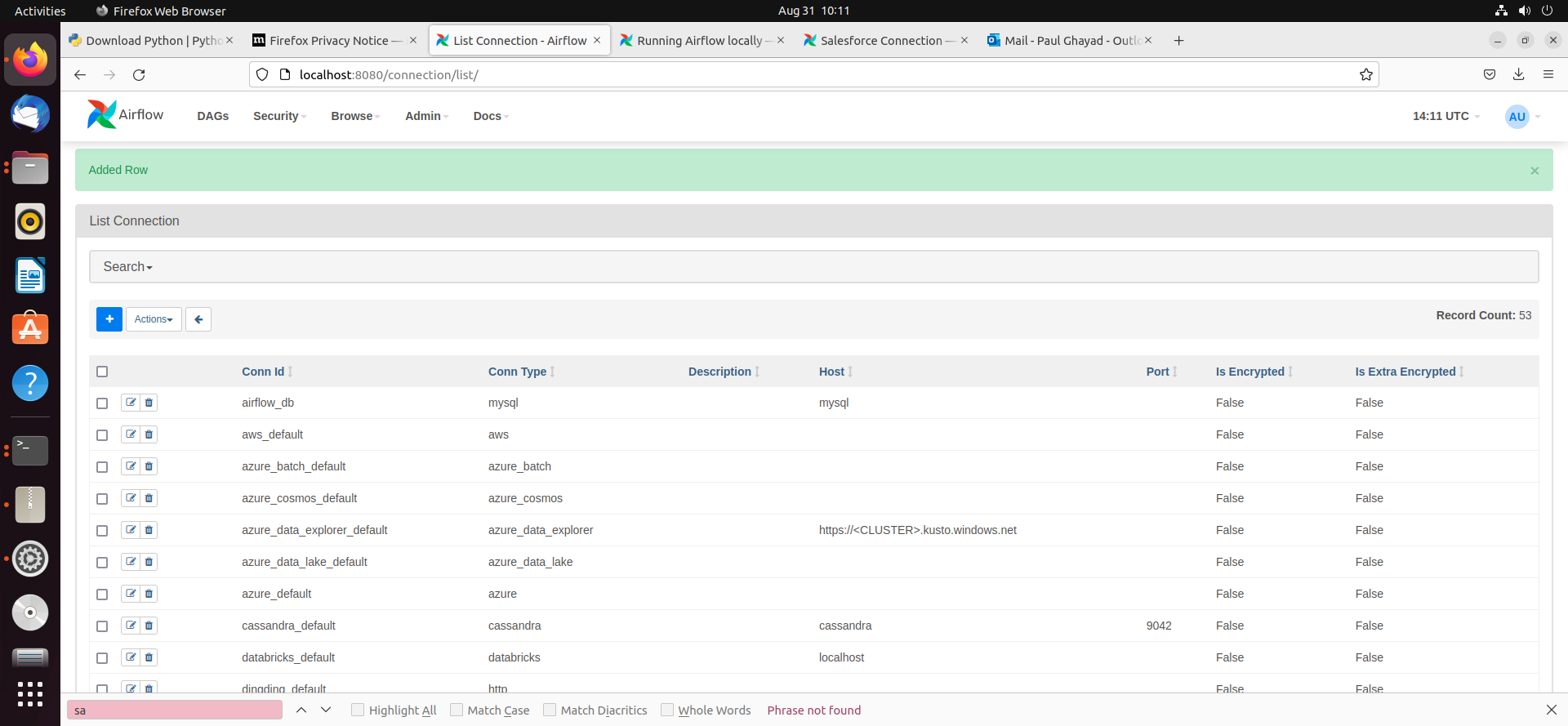

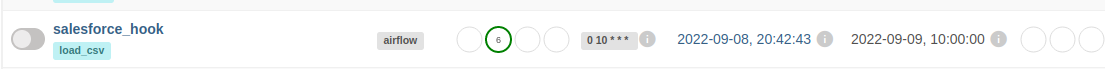

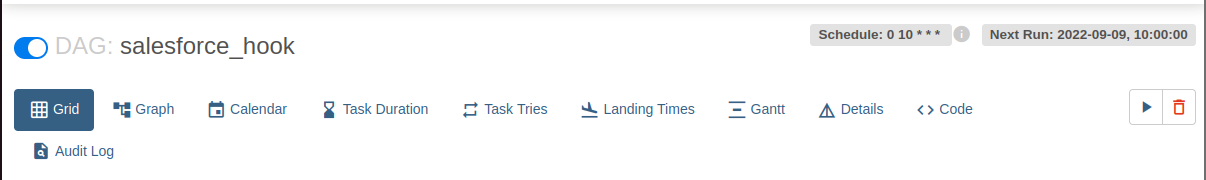

Airflow におけるDAG は、ワークフローのプロセスを格納するエンティティであり、DAG にトリガーを設定することでワークフローを実行することができます。 今回のワークフローでは、シンプルにSQL Analysis Services データに対してSQL クエリを実行し、結果をCSV ファイルに格納します。

import time

from datetime import datetime

from airflow.decorators import dag, task

from airflow.providers.jdbc.hooks.jdbc import JdbcHook

import pandas as pd

# Dag の宣言

@dag(dag_id="sql analysis services_hook", schedule_interval="0 10 * * *", start_date=datetime(2022,2,15), catchup=False, tags=['load_csv'])

# Dag となる関数を定義(取得するテーブルは必要に応じて変更してください)

def extract_and_load():

# Define tasks

@task()

def jdbc_extract():

try:

hook = JdbcHook(jdbc_conn_id="jdbc")

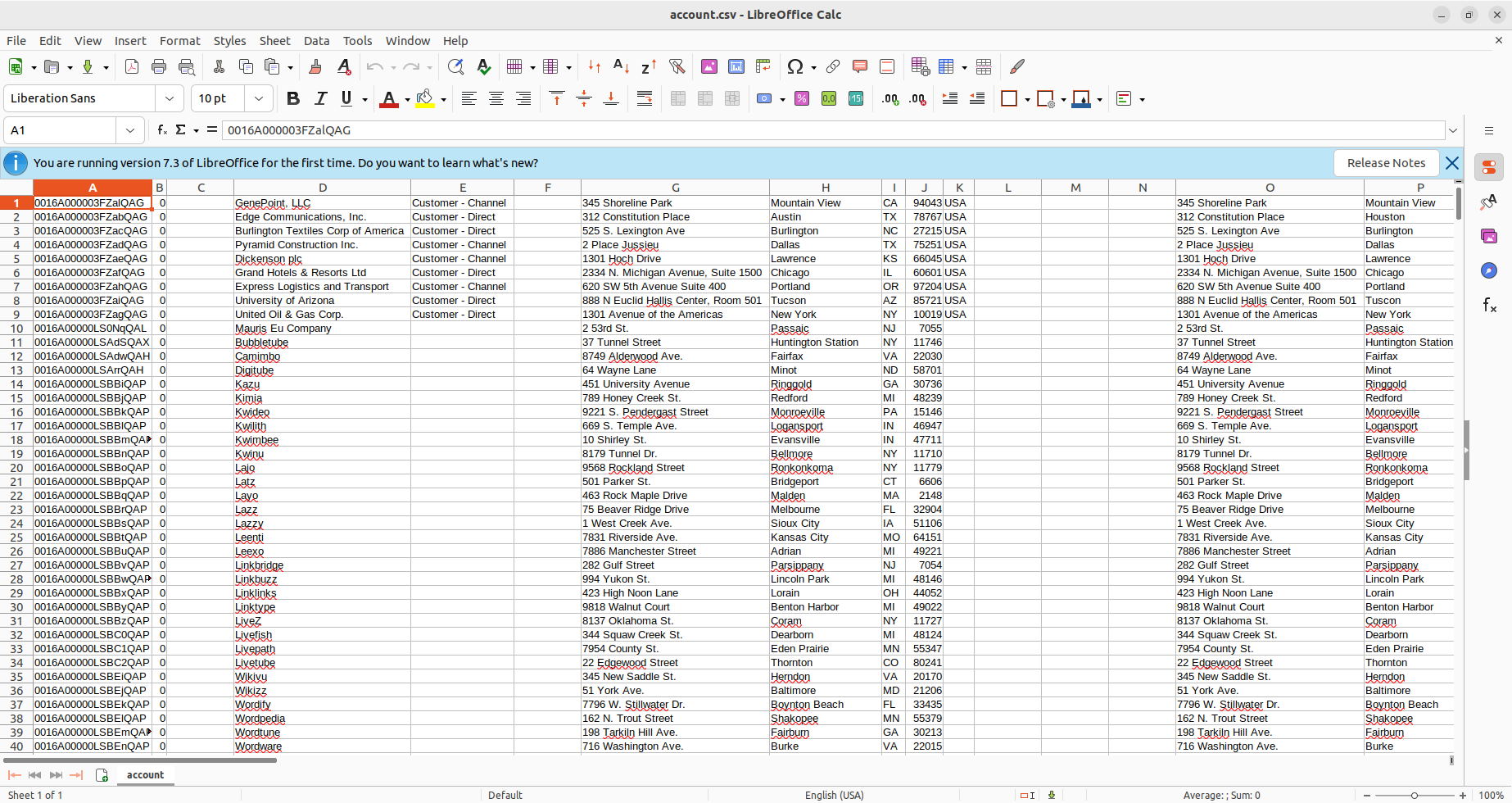

sql = """ select * from Account """

df = hook.get_pandas_df(sql)

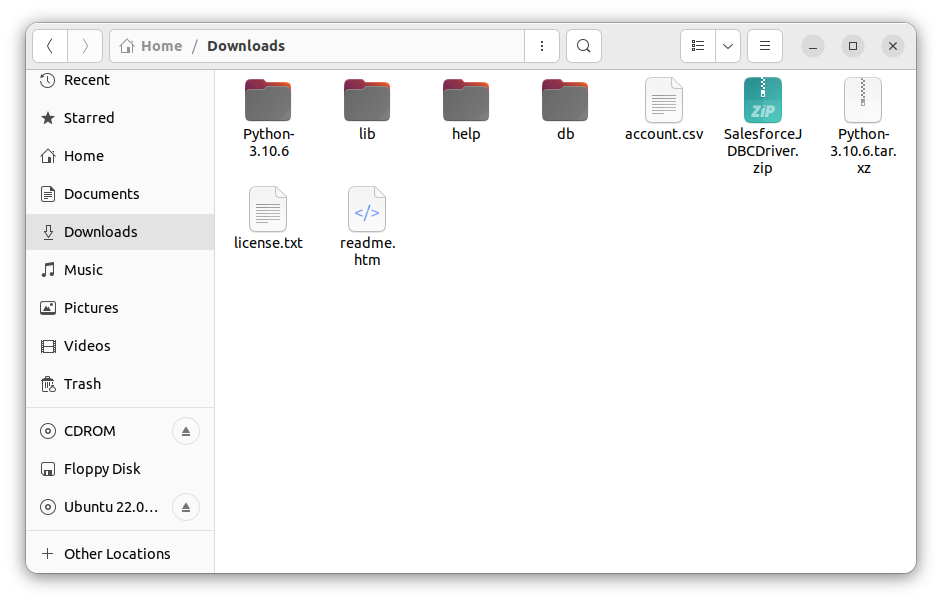

df.to_csv("/{some_file_path}/{name_of_csv}.csv",header=False, index=False, quoting=1)

# print(df.head())

print(df)

tbl_dict = df.to_dict('dict')

return tbl_dict

except Exception as e:

print("Data extract error: " + str(e))

jdbc_extract()

sf_extract_and_load = extract_and_load()