ノーコードでクラウド上のデータとの連携を実現。

詳細はこちら →

CData

こんにちは!プロダクトスペシャリストの宮本です。

Google Cloud Data Fusion は、ノーコードでデータ連携の設定が可能な言わば GCP の ETL ツール(サービス)です。たくさんのコネクタや変換・分析機能がデフォルトで用意されているため、さまざまなデータソースを色々な組み合わせで扱うことが可能なようです。 また JDBC を扱うこともできるため、この記事では、CData JDBC Driver for Sybase データ を使って、Sybase データ データをCloud Data Fusion でGoogle BigQuery にノーコードでパイプラインします。

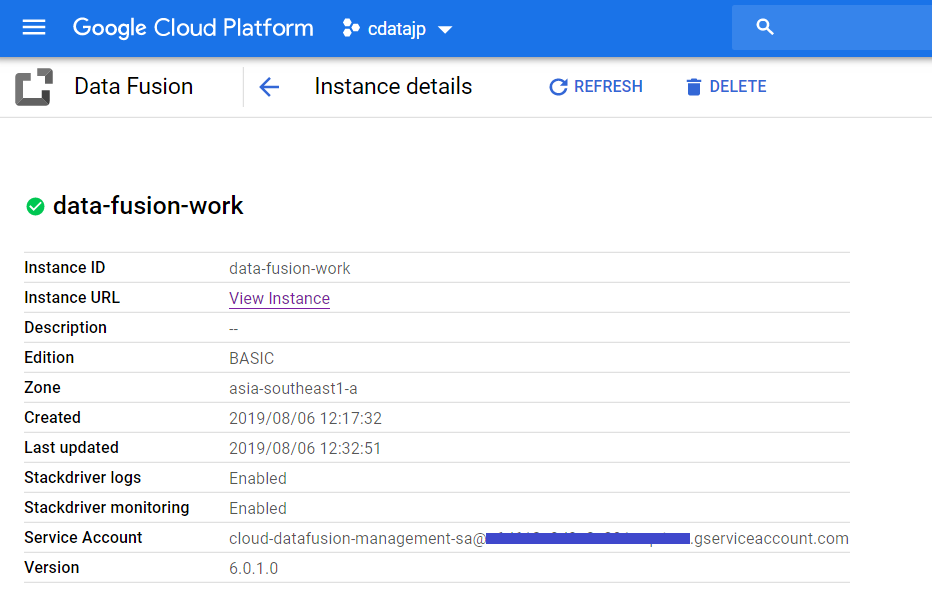

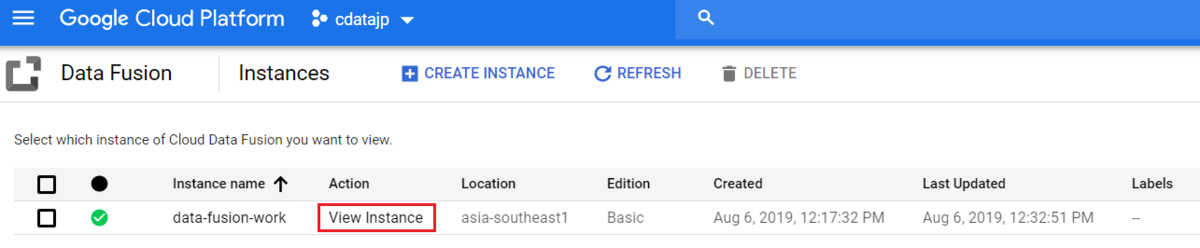

まずはCloud Data Fusion のインスタンスを作成します。

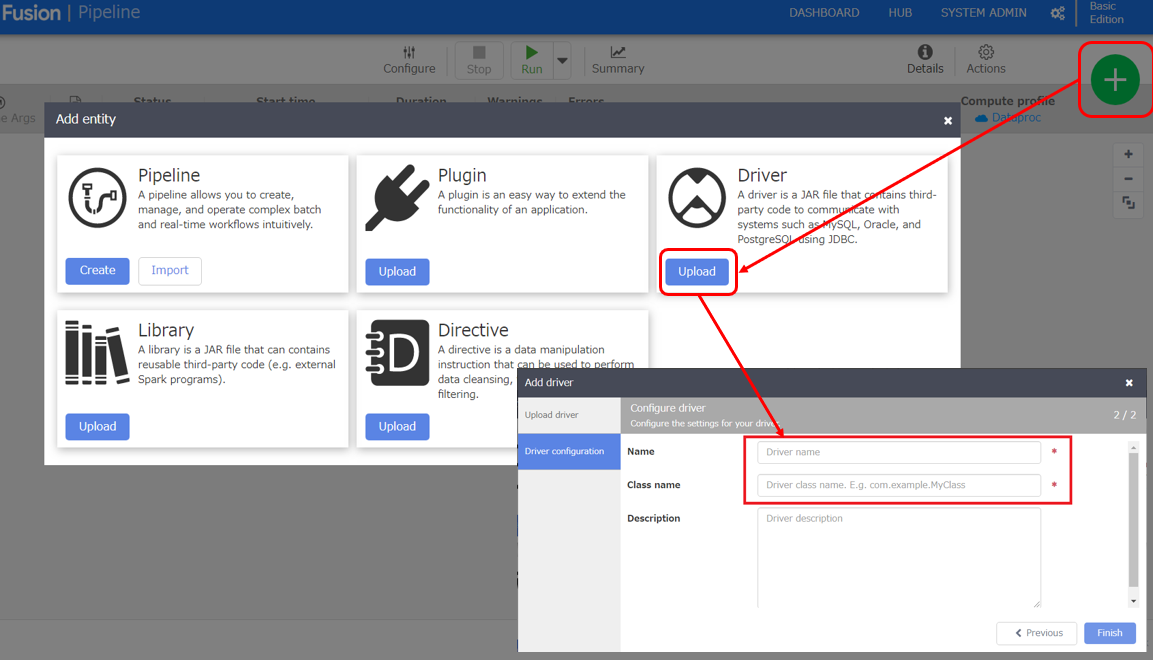

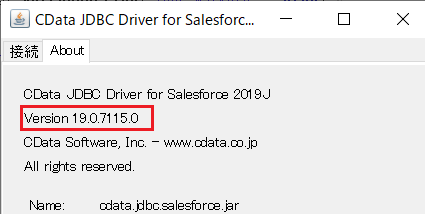

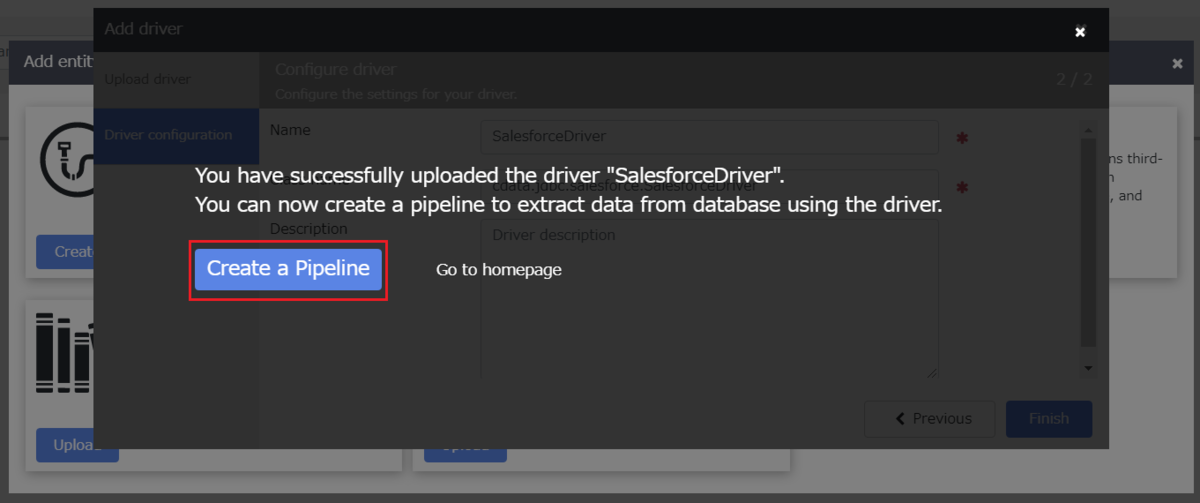

ここからは実際に、Data Fusion の設定をしていきます。 まずは JDBC Driver をアップロードを行います。

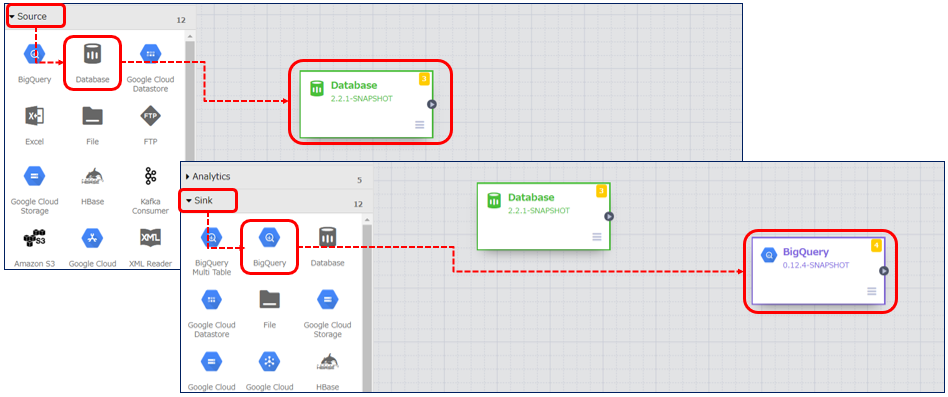

インプット元はサイドメニューの「Source」から選択します。今回は先ほどアップロードした Sybase データ の JDBC Driver を使用するため、「DataBase」を選択します。 アウトプット先は同じくサイドメニューより「Sink」→「BigQuery」を選択します。

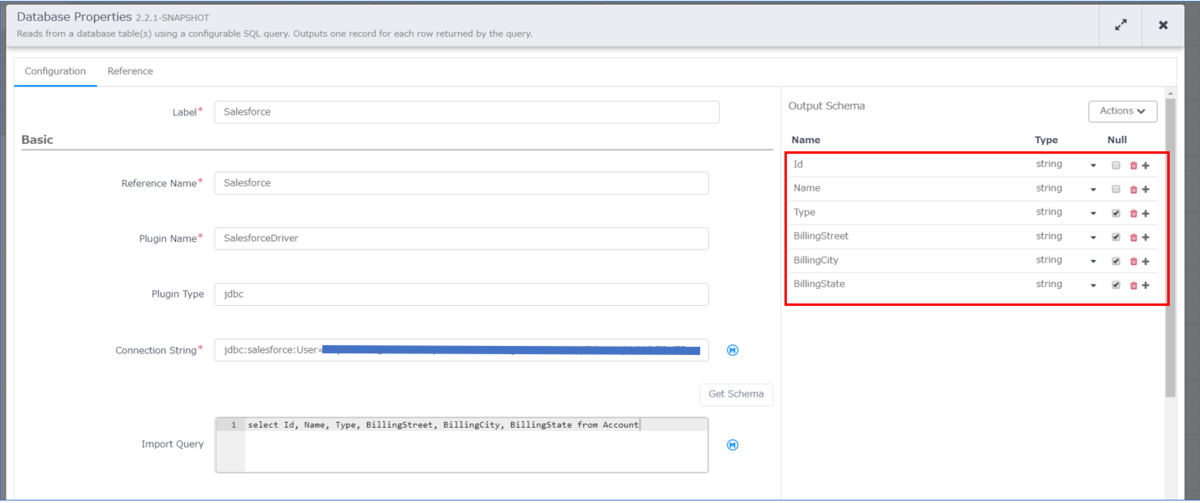

「DataBase」のアイコンにカーソルを持ってくるとプロパティというボタンが表示されるのでクリックし、下記内容を設定します。

Sybase は、Basic 認証、Kerberos 認証、LDAP 認証などの認証方法をいくつかサポートしています。

次を設定してデータを認証し接続します。User およびPassword を設定してSybaseIQ 認証を使用します。

オプションで、UseSSL をtrue に設定することにより、TLS/SSL で接続を保護できます。

Note: 上記のCData 製品 設定でSAP SQL Anywhere のインスタンスに接続することもできます。

Kerberos 認証を活用するには、次の接続プロパティを使用してそれを有効にすることから始めます。

Kerberos 認証用に設定する必要がある接続プロパティに関しては、Kerberos の使用 情報を参照してください。

以下は接続文字列の例です。

Server=MyServer;Port=MyPort;User=SampleUser;Password=SamplePassword;Database=MyDB;Kerberos=true;KerberosKDC=MyKDC;KerberosRealm=MYREALM.COM;KerberosSPN=server-name

LDAP 認証で接続するには、LDAP 認証メカニズムを使用するようにSybase サーバーサイドを設定する必要があります。

LDAP 用にSybase を設定したら、Basic 認証と同じクレデンシャルを使用して接続できます。

Connection String は以下の形式です。

jdbc:sybase:User=myuser;Password=mypassword;Server=localhost;Database=mydatabase;Charset=iso_1;

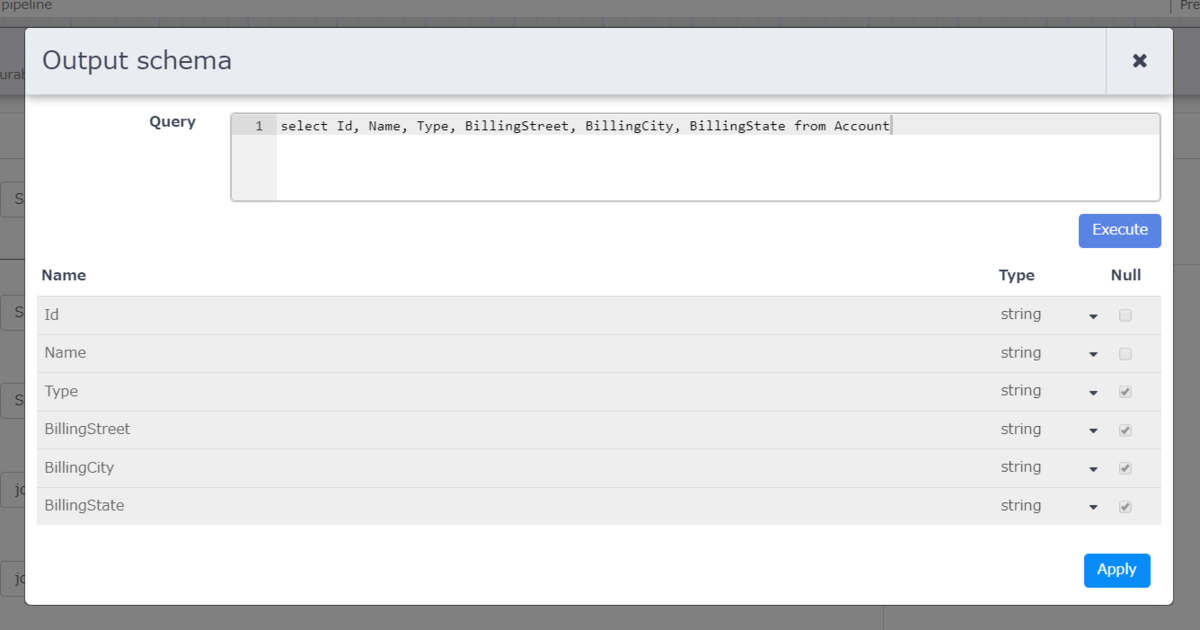

上のキャプチャの赤枠は、Salesforce から BigQuery へアウトプットするデータの定義となります。 こちらは「Import Query」のすぐ右上にある「Get Schema」をクリックすると下の画面が表示されますので、「Import Query」で入力したクエリを実行し、カラムを定義します。

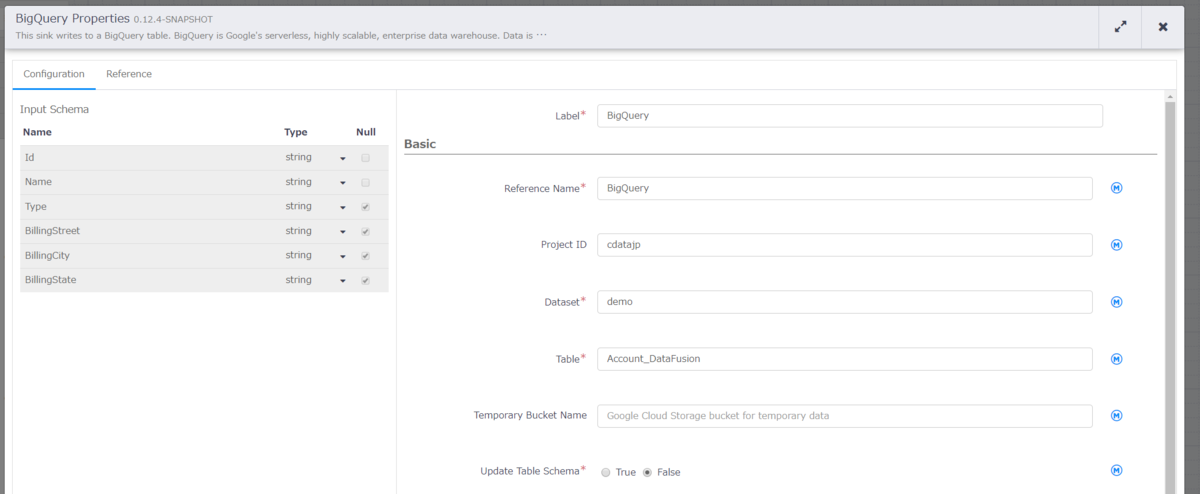

こちらも同様に BigQuery のプロパティから下記内容を設定します。

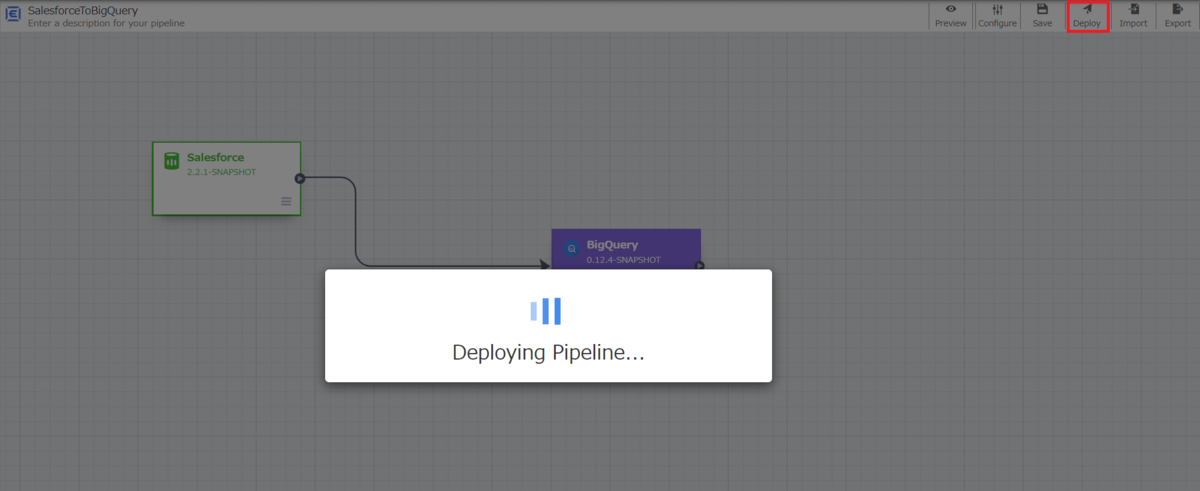

まずは作成したパイプラインをデプロイします。赤枠の「Deploy」ボタンをクリックしてデプロイを行います。

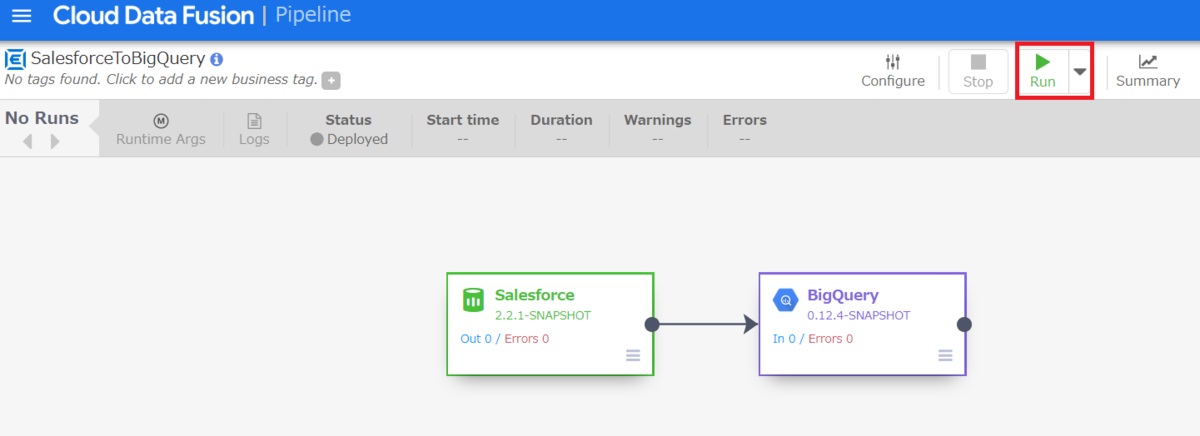

デプロイ完了後、Runボタンが表示されますので、クリックします。

このようにCData JDBC ドライバをアップロードすることで、簡単にGoogle Cloud Data Fusion でSybase データ データをノーコードで連携し、BigQuery などへのパイプラインを作成することができます。

是非、CData JDBC Driver for Sybase 30日の無償評価版 をダウンロードして、お試しください。